APPS · 2026年3月

TongCLI: 终端中的 CLI 工具

TongCLI 是一款运行在终端中的 CLI 工具,以编程的方式自主完成用户以自然语言描述的任务

简介

TongCLI 是一款运行在终端中的 CLI 工具,以编程的方式自主完成用户以自然语言描述的任务。TongCLI 的底层是 Judy:一个以多智能体架构为基础,专注于提升 CLI 系统的编程能力的引擎。Judy 旨在成为可以被复用到任何 Agentic 系统的核心引擎(harness)。

我们认为,随着 Agent 技术的发展,

我们认为,随着 Agent 技术的发展,

编程能力和 多智能体将成为所有 Agentic 系统的必不可缺的特性。核心能力

编程能力

突破预置工具限制,自由地与环境交互

一方面,目前仍有大量的软件/服务,未被封装成 Agent 可以调用的工具。

另一方面,为 Agent 预置大量的工具,将使得 LLM 的上下文被大量的工具定义填充,浪费 Token 且会影响 LLM 的性能。

而通过为 Agent 配备编程能力,只需要最少两个 Tool(代码编辑+代码执行),Agent 就能自由地使用所有的软件和服务,打破与现实世界交互的手和脚上的束缚,使得工具方面的限制不再成为 Agent 的能力瓶颈。

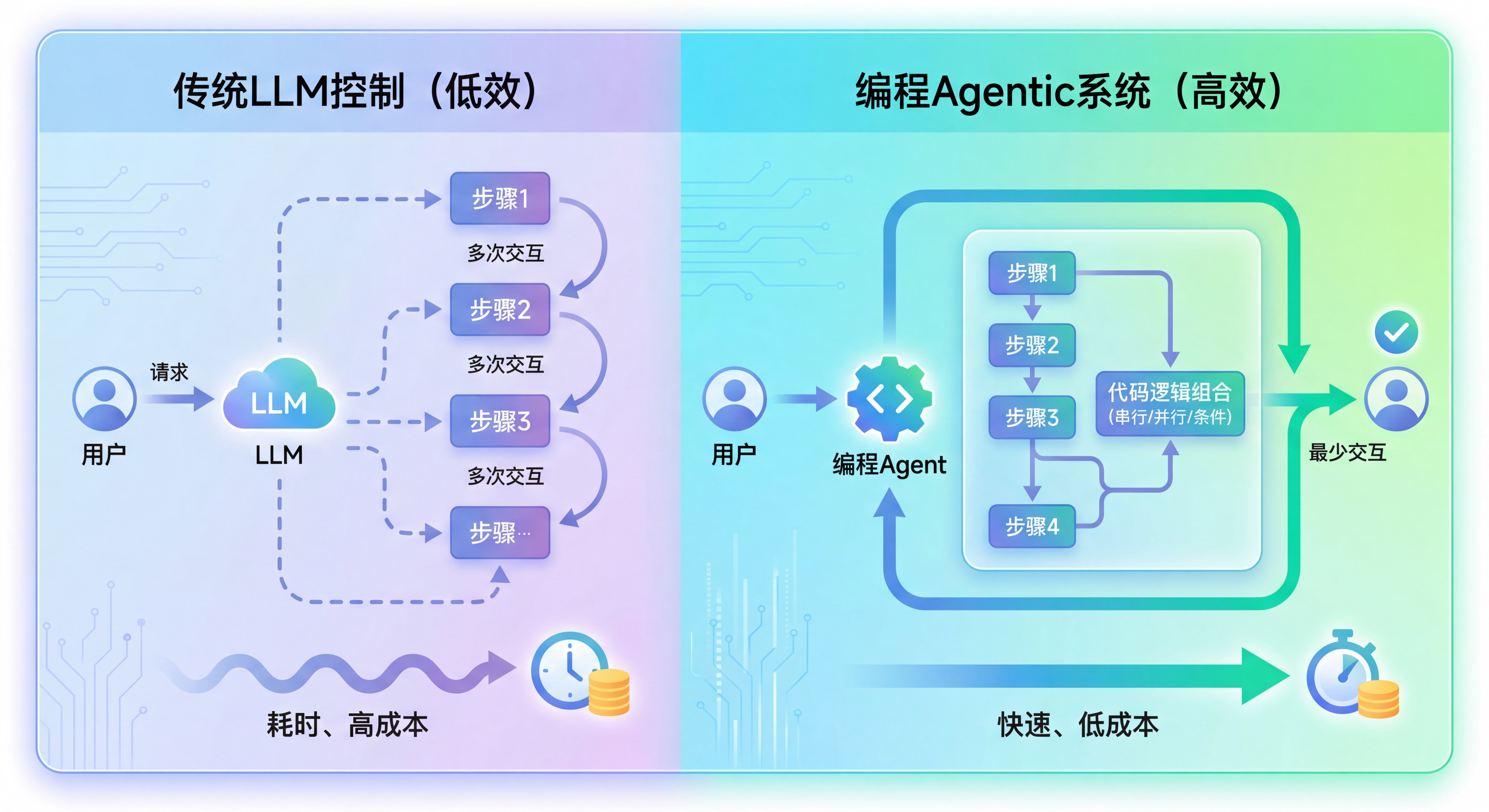

以最高效的方式运行,减少交互轮数

当任务的多个中间步骤需要串行、并行、循环、条件分支等确定性的逻辑规则进行组合时。

由于 Tool Call 缺乏对应的逻辑控制与组合结构,导致只能依靠 LLM 自身充当逻辑控制的角色,徒增交互轮数。

而借助于编程语言自身的逻辑控制结构,Agent得以通过代码组合多个步骤,避免步骤间不必要的 LLM 介入,减少交互轮数,降低时间和计算成本。

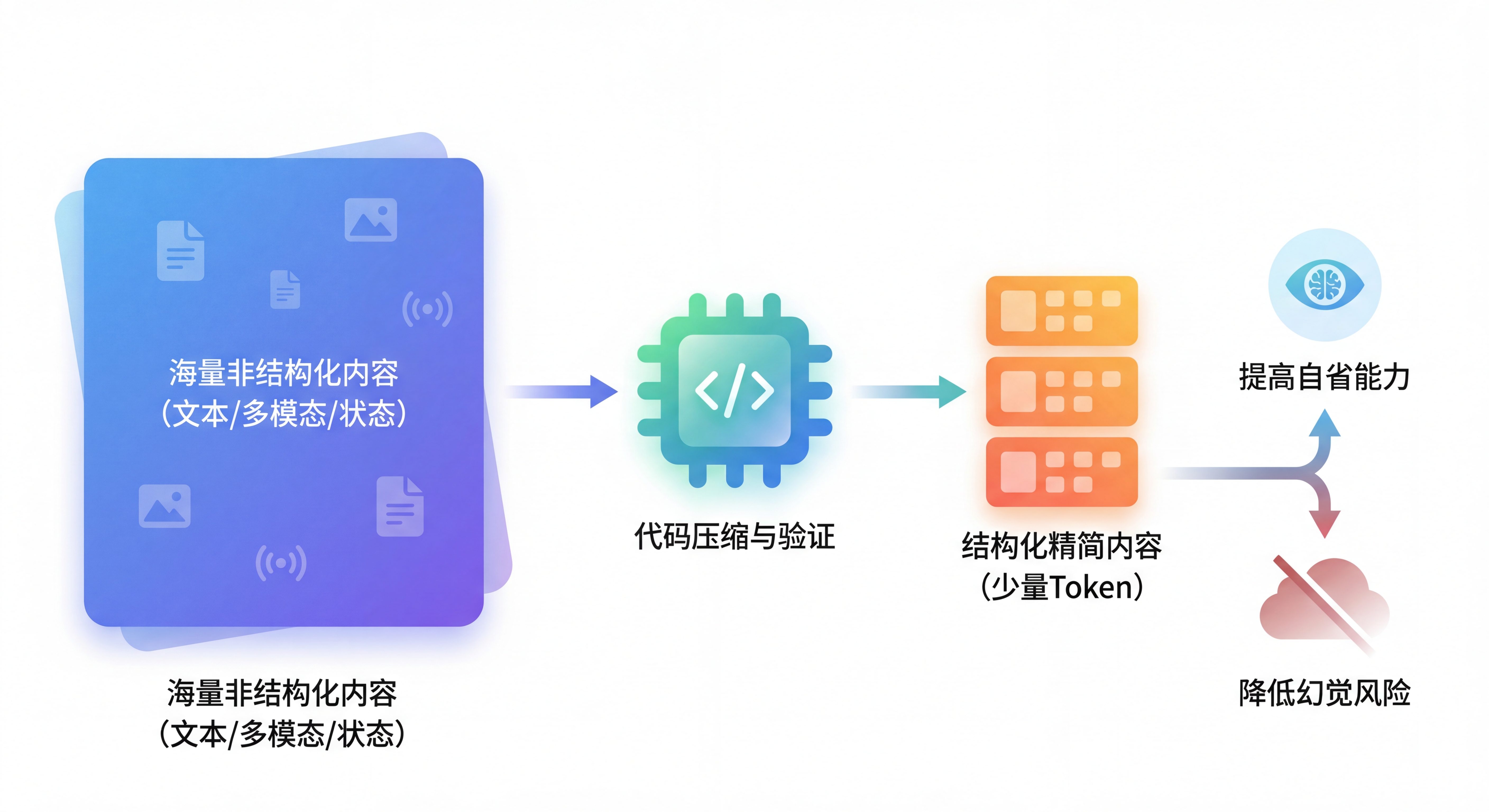

提高自省能力,降低幻觉风险

通过编写和运行代码,Agent 能够将需要海量 Token 表示的原始内容(文本、多模态、环境状态等),压缩为少量 Token 就能表示的结构化精简内容。

确定性、可复现的代码脚本/自动化验证脚本,加上结构化的处理结果/验证结果,能够提高基于概率模型的 Agent 的自省能力,降低盲目自信和幻觉的风险。

零摩擦套件,释放模型潜力

不同的 LLM 由于训练数据和训练方式的差异,在调用工具时的偏好不同,与 LLM 偏好不匹配的工具会降低调用的成功率。

另一方面,提供精准的环境信息和工具集,辅助 Agent 与环境进行丝滑地交互,对于释放模型潜力,提高 Agent 上限至关重要。

TongCLI 积累了大量工程经验,不断优化 Harness Design/Enginerring,在 Terminal-Bench 2.0 上达到了单轮最高 88.8% 的成绩。

多智能体

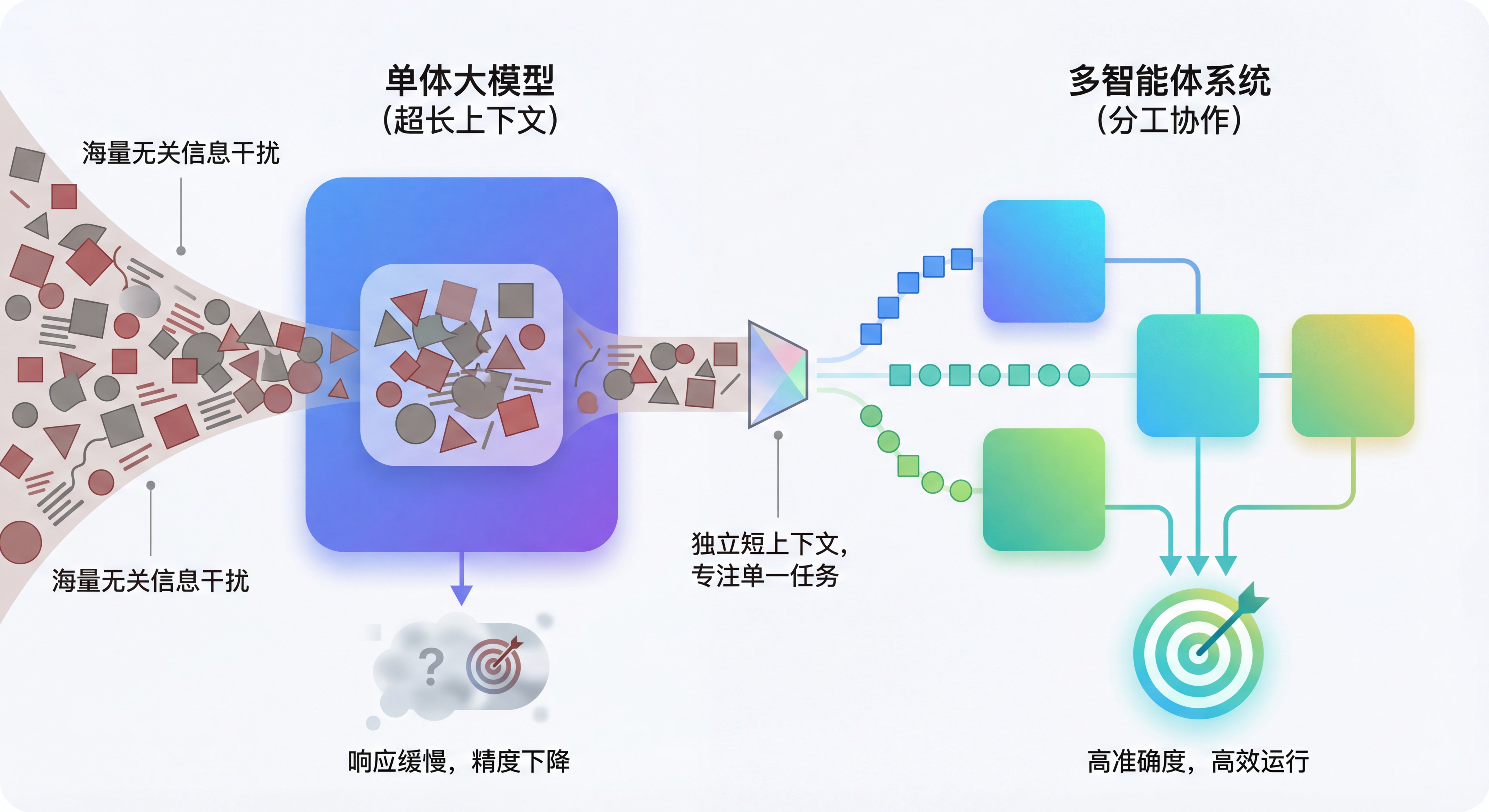

避免上下文过载,提高 Agent 准确度

大量研究表明,随着上下文长度的增长,LLM 的性能会不断下降。当上下文包含大量与当前任务无关的信息时,LLM 给出的回复会受到严重的干扰。

虽然大部分 LLM 现在支持长达 1M 的上下文,但价格高昂,时间和计算成本高,而且仅适用于

大海捞针等简单任务,在复杂任务上表现并不好。

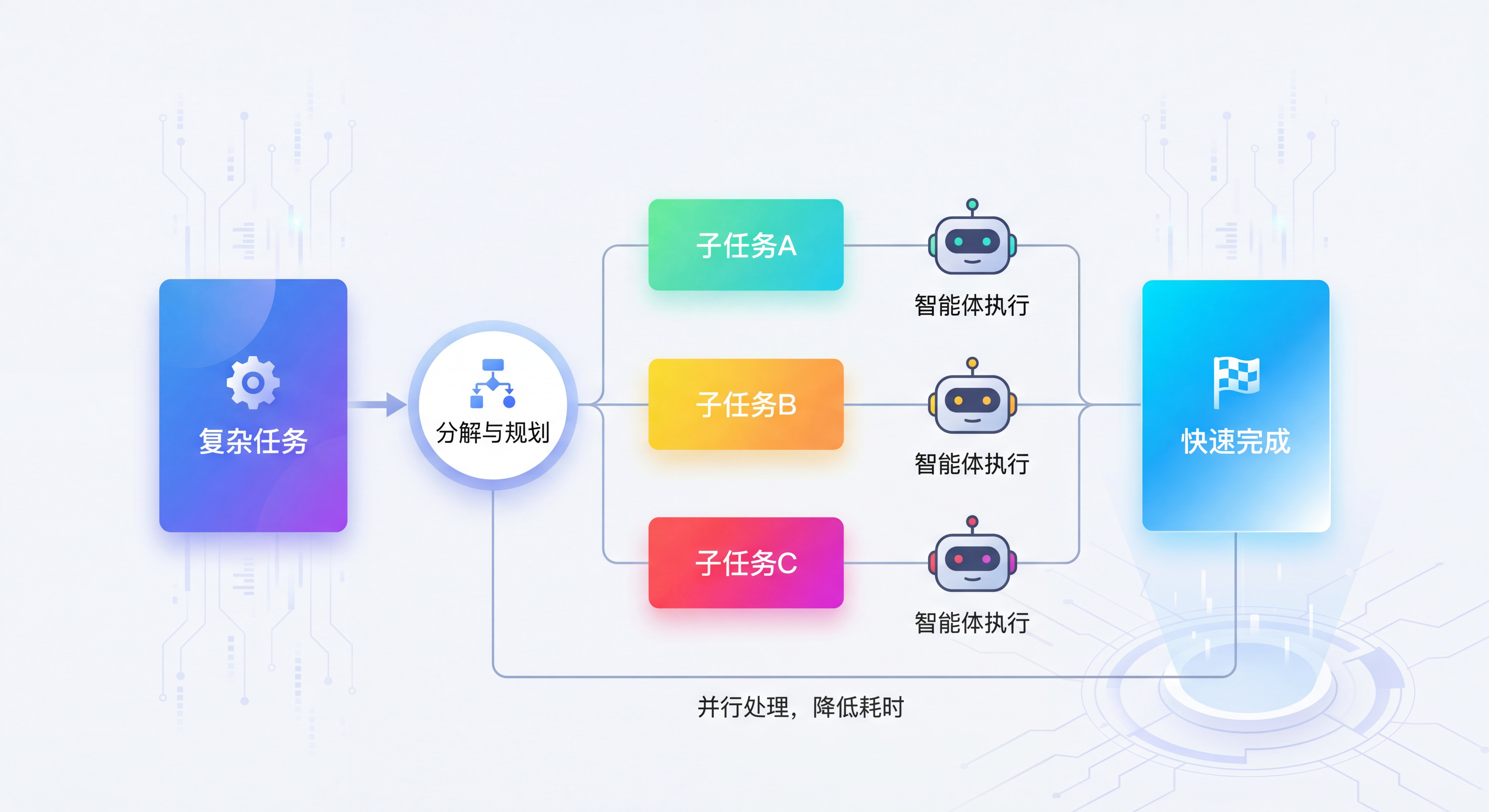

TongCLI 以 Agent 的数量换取单个 Agent 的上下文空间,严格限制单个 Agent 的步数和上下文长度,保证了单 Agent 的精度。子任务并行,降低任务耗时

TongCLI 在规划阶段,会将复杂任务拆分成由子任务构成的有向无环图,分析出可以并行的子任务,并交由不同的 Agent 执行,实现子任务的并行。

集思广益,探索多种可能

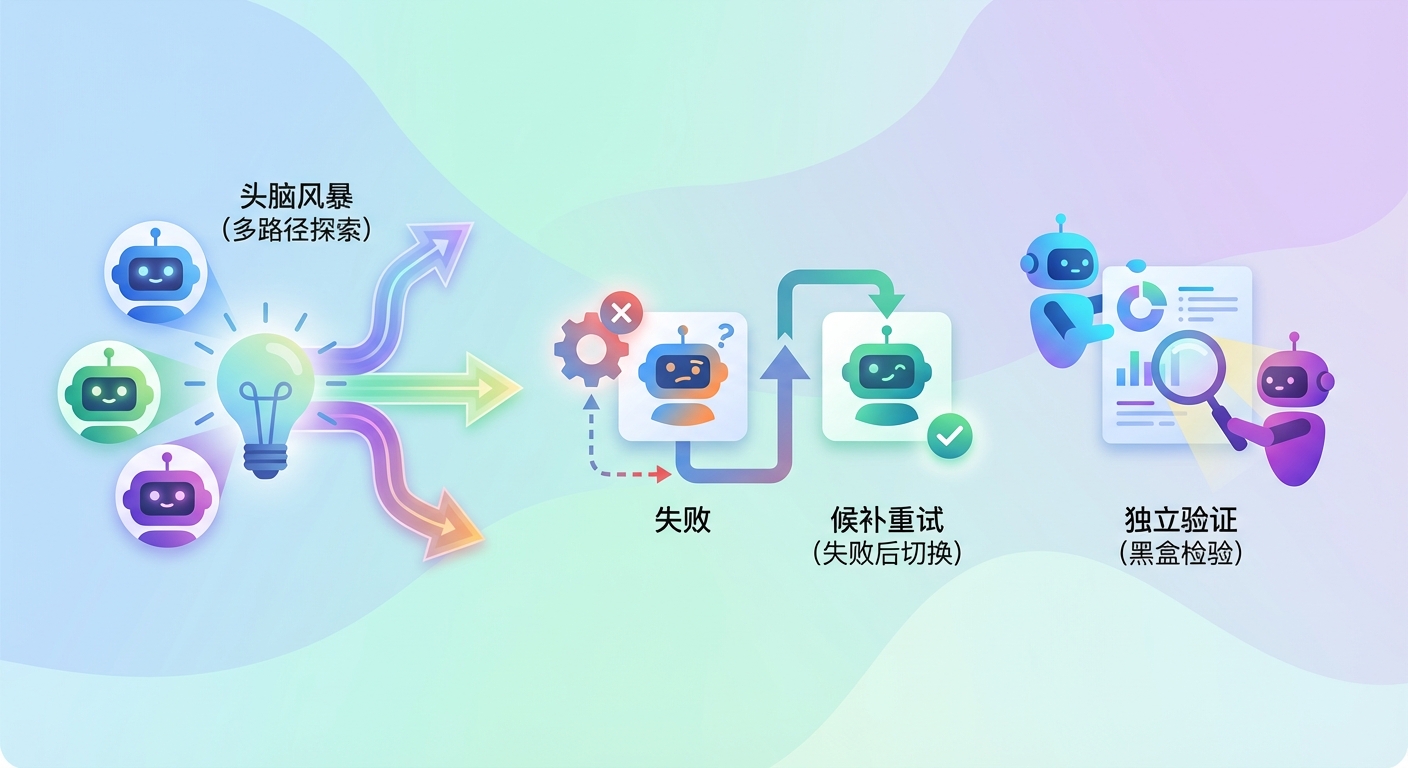

不同的 LLM 所擅长的领域各不相同。通过引入配备了不同 LLM 的 Agent,TongCLI 支持:

- 头脑风暴:由配备了不同 LLM 的 Agent 集思广益,拓宽任务执行路径

- 候补重试:当某个子任务执行失败后,切换为配备了另一个 LLM 的 Agent 来重试

- 独立验证:由配备不同 LLM 的 Agent 对结果进行黑盒检验。避免同一个 LLM 验证是出现的白盒验证,自我循环论证的问题,提高验证流程发现问题的概率。