RESEARCH · 2026年3月

$OneMillion-Bench: 定义“行业数字员工”上岗标准

TongAgents 团队发布高生产价值行业智能体基准 $OneMillion-Bench,重新定义「可交付」智能

在 AI 智能体逐渐从概念走向落地应用的今天,我们不禁要问:AI 究竟能在多大程度上承担真实世界中的高价值专业工作?它创造的「可交付价值」能否被客观衡量?

近日,北京通用人工智能研究院(BIGAI)TongAgents团队联合 Humanlaya、红杉(中国)xbench 评测团队、M-A-P,发布了一项开创性的评测基准—— $OneMillion-Bench(百万美金基准)。

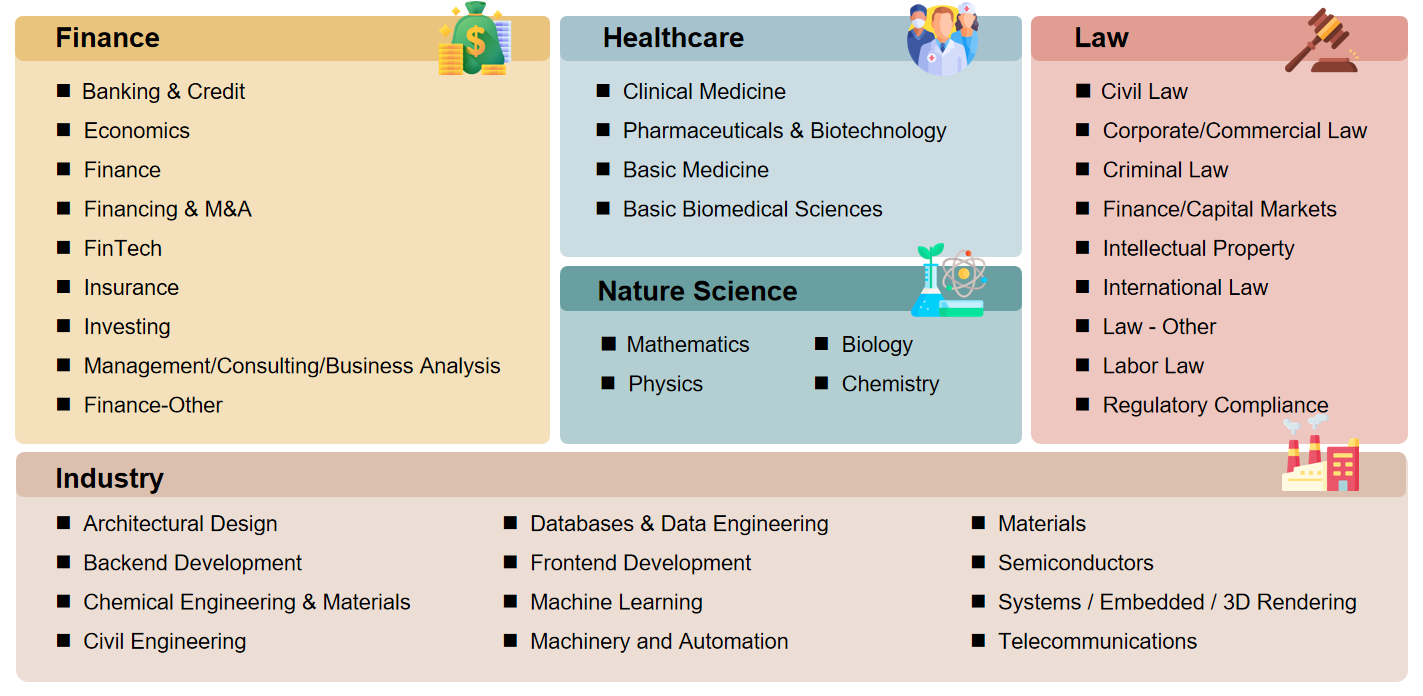

$OneMillion-Bench 构建了一套兼备高经济价值 × 高区分度 × 可自动评测的基准,包含 400 道高难题目(200 个英文 + 200 个中文),覆盖金融、法律、医疗、自然科学与工业五大领域的 92 个三级领域。该基准首次以「人类专家的时间与成本」为标尺,量化评估 AI 智能体在真实行业场景中能稳定交付的经济价值。

背景

从「答题机」到「生产力」:为什么行业需要一把新标尺?

随着智能体技术进入"落地元年",AI 正从传统的问答与内容生成,迈向承担复杂工作流的"数字员工"。然而,业界长期缺乏能够有效衡量智能体在实际业务中创造经济价值能力的评测体系——现有基准多聚焦于知识点考查的封闭任务,在区分度、自动化评测、尤其是真实业务场景还原度上存在明显局限。

$OneMillion-Bench 是产业实践中的关键延伸:我们不仅关注模型"知道什么",更关注它能否在真实、开放、高价值的专业任务中,像人类专家一样规划、推理、决策并交付可落地的成果。

设计理念

百万美金价值从何而来?构建真实世界的价值度量衡

$OneMillion-Bench 的核心设计理念直白而深刻:用货币度量智能体的经济价值。

我们联合来自摩根士丹利、世达律师事务所、北京协和医院、国家电网、清华大学等机构的 100 余位资深专家,历时超 2,000 小时,共同构建了覆盖五大核心领域的 400 道高难度开放任务。每道题背后都对应一个真实的专家级工作场景。

每个任务的经济价值,由完成该任务所需的专家耗时 × 权威市场时薪共同决定(数据来源于中美官方统计及最新行业报告)。所有任务总经济价值累计超过 100 万美元,意味着在现实世界中完成这套题,需要支付百万美元级别的专家费用。

核心设计

四大关键设计原则

01

高真实性、高价值任务

测评题目收集自 5–15 年经验从业者的真实工作流,每道题被拆解为 15–35 个细粒度考点(累计超 7,000 个),重点考核特定场景下的专家级决策与实操能力,而非泛泛知识点记忆。

02

非对称负分机制,严防「表面正确」

为避免 AI 通过堆砌内容"骗取"高分,我们首创了包含扣分项的评测方案。重大错误或逻辑缺陷将受到更重的惩罚(例如 −20 分),引导模型追求扎实、严谨和可靠的输出。

03

深度融合中外行业场景

基准包含独立的中文(CN)与英文(Global)子集,覆盖 92 个三级行业分类,严格还原本地法规、流程与业务语境,精准衡量地域化专业能力。

04

专家级工业化生产 Pipeline

严格的专家选拔(通过率 <5%)与多人协作、对抗评审和仲裁质检流程保障数据质量——题目最终质检通过率仅 38.1%,从源头确保高难度与高保真度。

核心发现

AI 已能创造可观价值,但「可靠交付」仍是下一站

基于 $OneMillion-Bench 评测结果,我们得出了对当前 AI 智能体能力边界的清晰洞察:

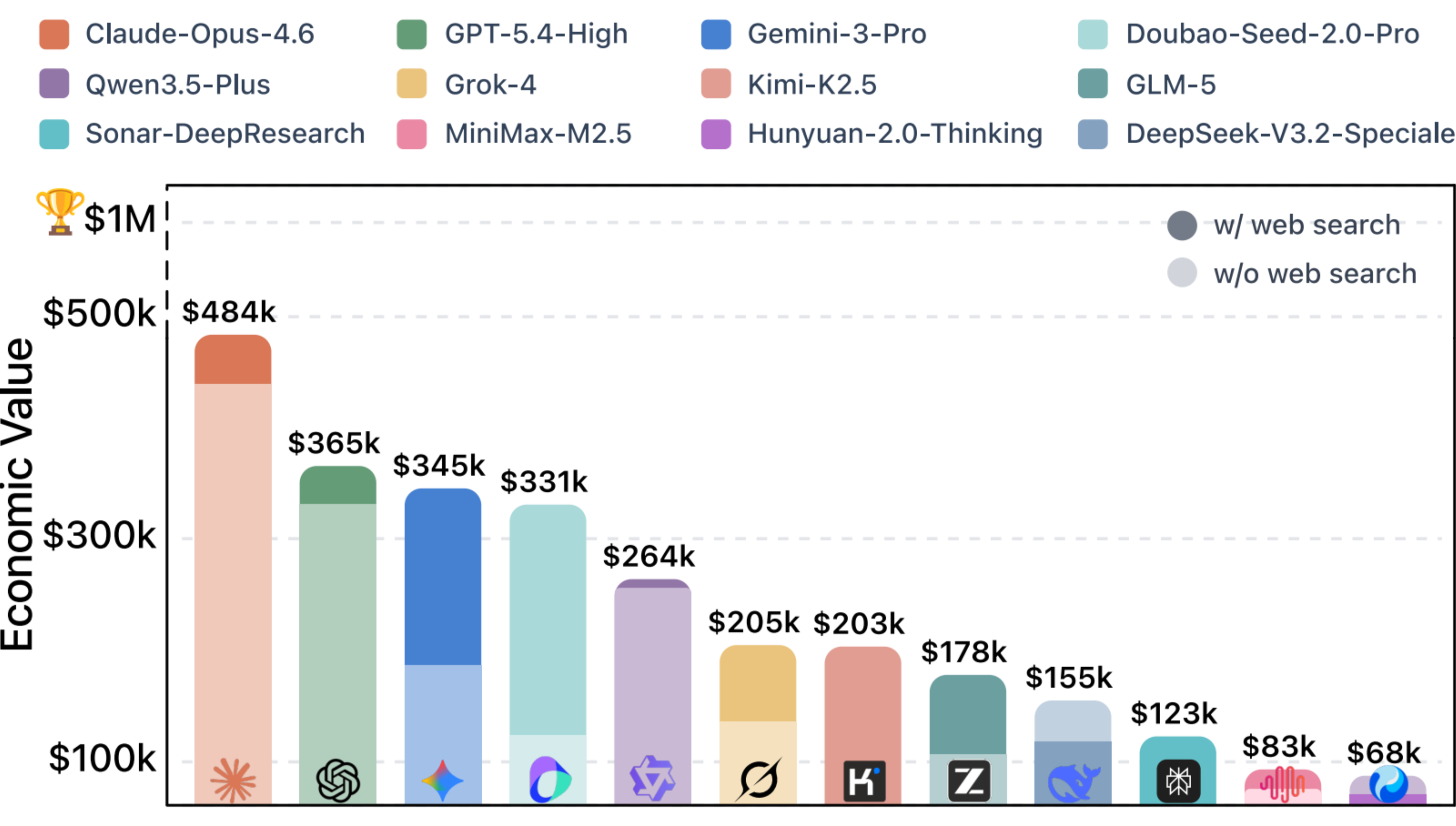

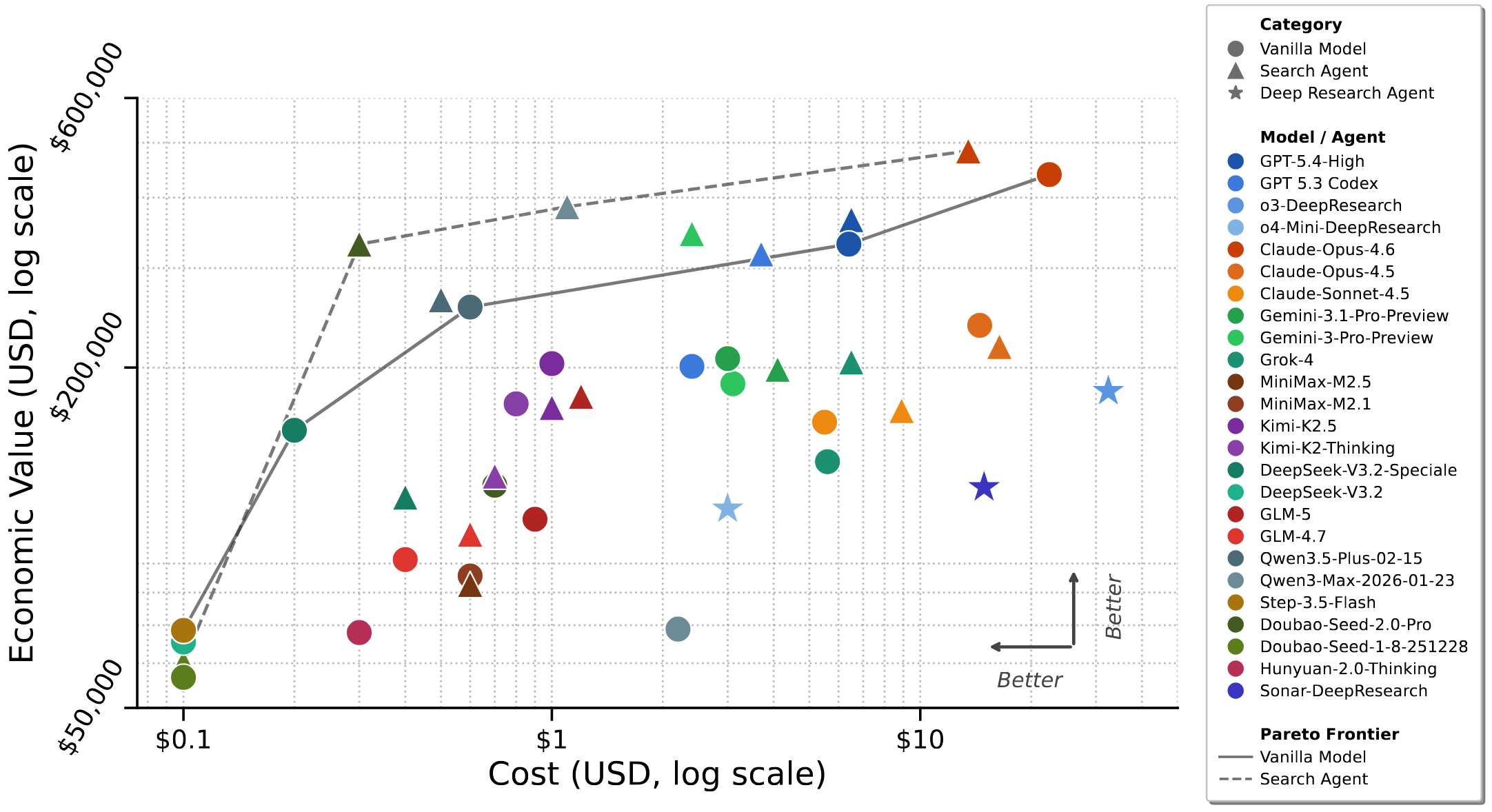

价值创造能力显著

当前顶尖模型在此基准上可产出约 48 万美元的经济价值,而完成这些任务的模型调用 API 成本仅约 100 美元。这证明 AI 在极高单价的专业任务上已具备强大的价值创造潜力。

「通过率」揭示交付鸿沟

尽管头部模型平均分已"及格"(>60%),但以更严格的通过率标准(单题得分 ≥70% 视为可交付)衡量时,即便是最佳模型,也仅能稳定交付约 45% 的任务。AI 虽已能"帮忙",但距离完全独立、可托付地完成复杂工作流仍有差距。

复杂推理与细节深挖是共性瓶颈

模型在需要多步深度演绎、探索式求解或极致可操作细节的任务中,仍容易出现逻辑跳步或泛泛而谈。这正是 TongAgents 致力于提升可解释、可信决策的核心攻克方向。

展望

迈向「可交付的人工智能」

$OneMillion-Bench 的发布,不仅仅是一个排行榜。它是前沿基础研究与重大产业需求相结合的一次重要实践,为行业智能体框架开发和优化提供了明确的方向与严苛的试金石。未来行业智能体将持续聚焦于:

🧠

深层推理与规划

让智能体不仅能"答对",更能"想透"。

🏭

可靠落地

确保在真实、动态的业务环境中输出高确定性结果。

🤝

人机协作

让智能体成为人类专家可信、可用、可协同的"专业伙伴"。

站在智能体技术爆发的临界点,我们邀请学术界与产业界的同仁共同关注、使用并完善这一基准。让我们共同推动 AI 智能体跨越从「演示效果」到「稳定交付」的关键一步,让智能的每一分进步,都切实转化为推动行业发展的生产力。

AI AgentsBenchmarkingEconomic Value$OneMillion-Bench

Authors

Qianyu Yang*1, Yang Liu*2, Jiaqi Li*2, Jun Bai*2, Hao Chen2, Kaiyuan Chen3, Tiliang Duan1, Jiayun Dong1, Xiaobo Hu3, Zixia Jia2, Yang Liu3, Tao Peng1, Yixin Ren3, Ran Tian1, Zaiyuan Wang1, Yanglihong Xiao1, Gang Yao2, Lingyue Yin1, Ge Zhang4, Chun Zhang1, Jianpeng Jiao†1, Zilong Zheng†2, Yuan Gong†3

1 Humanlaya, 2 BIGAI TongAgents, 3 xbench, 4 M-A-P

* Core contributors. † Corresponding authors.